Cloud News: PowerPoint más inclusivo, Clipchamp renovado con IA y Phi-2: el SLM de Microsoft que supera a grandes modelos

Viernes 15 de diciembre de 2023

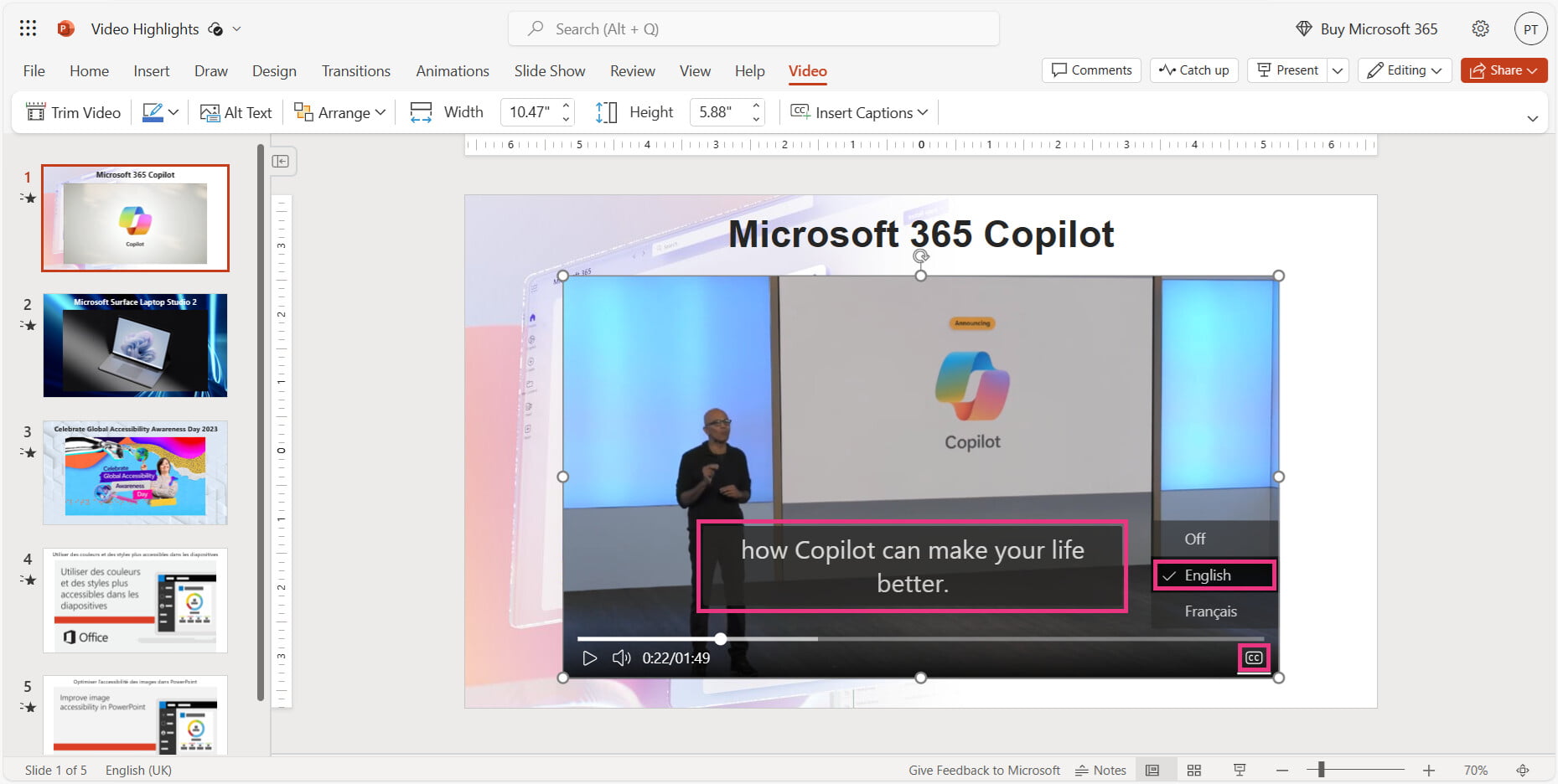

Presentaciones de PowerPoint más accesibles e inclusivas

Si quieres hacer tus presentaciones de PowerPoint más accesibles e inclusivas, una buena opción es añadir subtítulos y transcripciones a los vídeos que insertes en ellas. De esta forma, podrás facilitar la comprensión de tu mensaje a personas que hablen otro idioma, que tengan dificultades auditivas o que simplemente quieran ver los vídeos sin molestar a los demás.

Qué formato usar para los subtítulos y transcripciones

Para poder añadir subtítulos y transcripciones a los vídeos de PowerPoint, necesitas crearlos previamente en el formato WebVTT. Este es un formato estándar que se usa para sincronizar texto con audio o vídeo en la web. Puedes crear los archivos WebVTT con diferentes aplicaciones, incluso con un editor de texto simple como el Bloc de notas.

Los subtitulos en PowerPoint

En el sitio de soporte de Microsoft, puedes encontrar ayuda para crear los archivos WebVTT, así como algunos ejemplos de cómo deben estar estructurados. Básicamente, un archivo WebVTT tiene una cabecera con el tipo de archivo y una serie de bloques con el tiempo de inicio y fin de cada subtítulo o transcripción, seguido del texto correspondiente.

Cómo insertar los subtítulos y transcripciones en los vídeos de PowerPoint

Una vez que tengas los archivos WebVTT creados, el siguiente paso es insertarlos en los vídeos de PowerPoint. Para ello, debes iniciar sesión en el sitio web de PowerPoint con tu cuenta de Microsoft. Luego, debes abrir un archivo de PowerPoint, seleccionar Insertar, luego seleccionar Vídeo y finalmente seleccionar Insertar vídeo desde (Este dispositivo) para elegir el vídeo local que quieras insertar en la presentación.

Finalmente, puedes seleccionar Vídeo y luego Insertar subtítulos. Ahí podrás seleccionar el archivo WebVTT que hayas creado para los subtítulos o transcripciones del vídeo y se insertará junto con el vídeo en la aplicación web de PowerPoint.

Cómo ver los subtítulos y transcripciones en los vídeos de PowerPoint

Las personas que vean el vídeo en la aplicación web de PowerPoint podrán hacer clic en el botón de Subtítulos que se encuentra en la esquina inferior derecha del reproductor de vídeo para empezar a mostrar el texto en la pantalla. Si has insertado más de un archivo WebVTT para el mismo vídeo, podrán elegir el idioma que prefieran.

Microsoft indica que puedes insertar más de un archivo WebVTT para el mismo vídeo, lo que es ideal para incluir varios idiomas. Simplemente debes añadir el nombre de la configuración regional estándar al final del nombre del archivo antes de insertar cada uno. Por ejemplo, MyClosedCaptions.en.vtt para inglés, MyClosedCaptions.es.vtt para español.

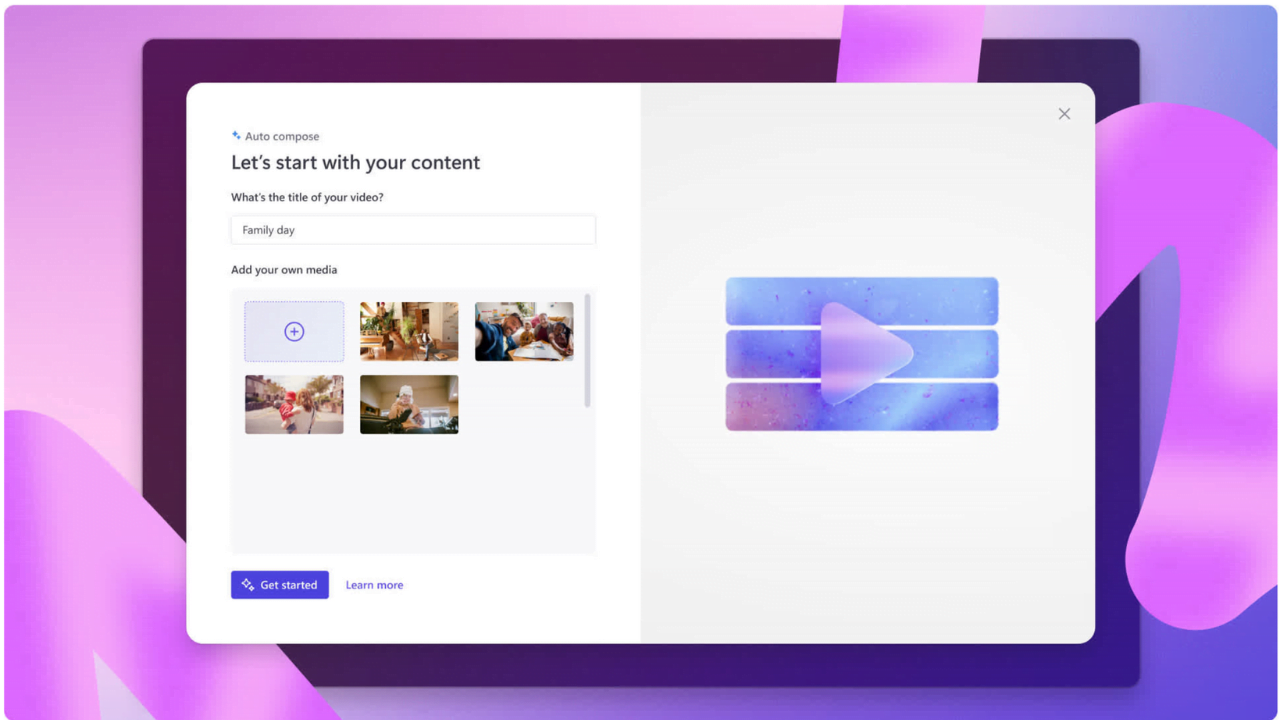

Clipchamp se renueva con la IA, nueva biblioteca de contenidos y grabación de voz

El gigante de Redmond lo tenía muy claro en 2021 cuando adquiría Clipchamp. Este desconocido editor de video en la nube parecía cumplir una serie de requisitos que Microsoft buscaba. Ahora ha lanzado una actualización para su editor de vídeo en la nube, Clipchamp, que introduce varias funciones nuevas destinadas a mejorar la facilidad y la eficiencia de la creación de vídeo.

Auto Compose: crea vídeos automáticamente con inteligencia artificial

Una de las funciones más destacadas de la actualización es Auto Compose, una herramienta impulsada por la inteligencia artificial que puede generar vídeos automáticamente a partir de fotos y vídeos. Los usuarios solo tienen que subir sus medios, elegir un estilo y dejar que la IA haga el resto. Auto Compose puede ser una forma estupenda de crear vídeos rápidos y fáciles para redes sociales, presentaciones u otros fines.

Biblioteca de contenido: accede a una amplia gama de recursos para tus proyectos

La actualización también incluye una nueva biblioteca de contenido que proporciona a los usuarios acceso a una amplia gama de vídeos, imágenes, música y gráficos de stock. La biblioteca es buscable y está organizada por categorías, lo que facilita encontrar los activos perfectos para tu proyecto de vídeo.

Grabación de voz: añade narración o explicaciones a tus vídeos

Y por último, Clipchamp ahora permite a los usuarios grabar voz en off directamente dentro de la aplicación. Esto haría que fuera muy fácil añadir narración o explicar conceptos en tus vídeos. La actualización también incluye mejoras en la función de texto a voz de Clipchamp.

Estas nuevas funciones están disponibles para todos los Insiders de Microsoft 365 con una cuenta personal. También se pueden acceder a través de la aplicación web o móvil de Clipchamp.

La grabación de audio está actualmente disponible para todos los usuarios con una cuenta personal, mientras que el despliegue de la edición de texto a voz comenzó el 30 de noviembre y estará disponible para las cuentas de trabajo a principios de 2024.

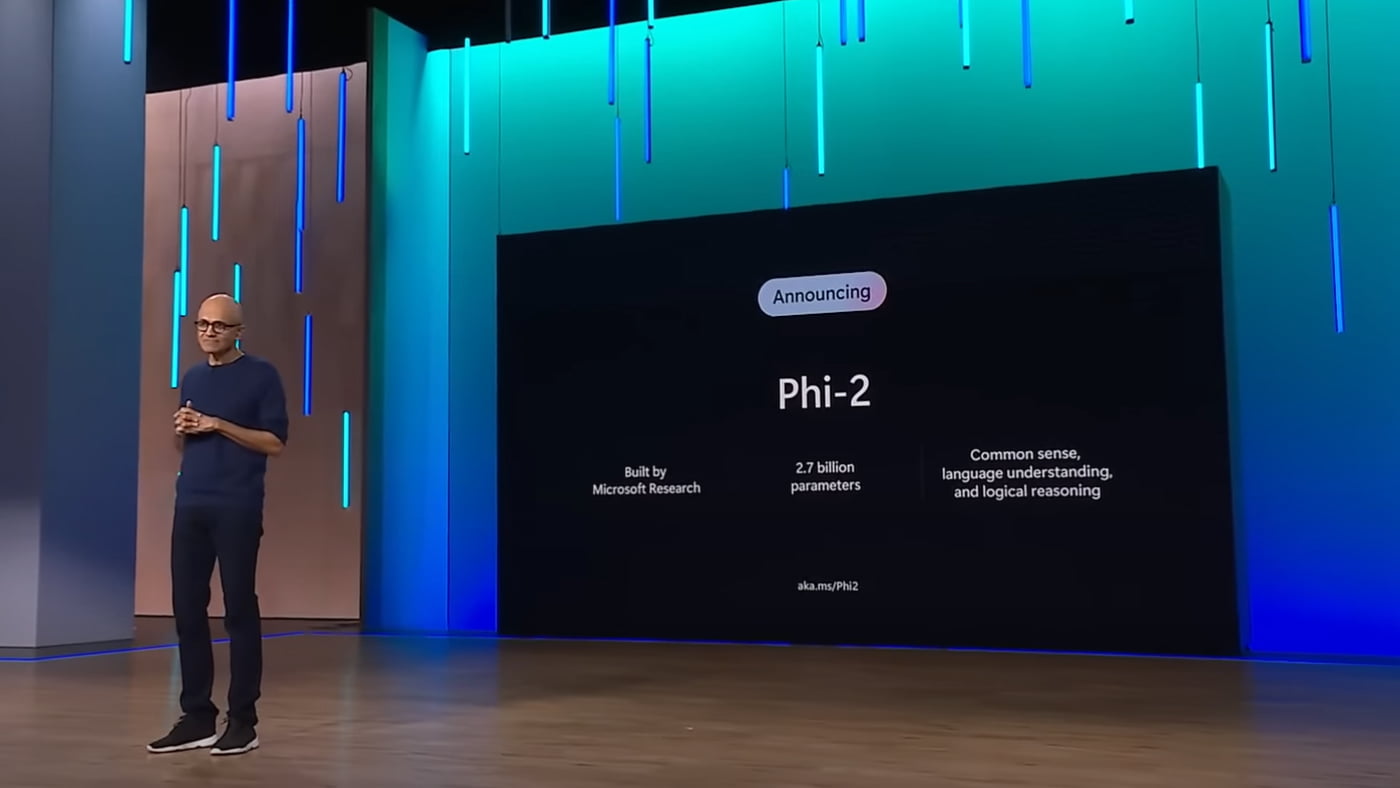

Phi-2 iguala o supera a muchos modelos hasta 25 veces más grandes

En los últimos meses, Microsoft Research ha estado lanzando una serie de modelos de lenguaje pequeños (SLM) llamados “Phi”. El primero fue Phi-1, con 1.3 mil millones de parámetros, especializado para la codificación básica de Python. En septiembre, Microsoft Research lanzó el modelo Phi-1.5 con 1.3 mil millones de parámetros, pero fue entrenado con una nueva fuente de datos que incluía varios textos sintéticos de NLP. A pesar de su pequeño tamaño, Phi-1.5 estaba entregando un rendimiento casi de última generación en comparación con otros modelos de tamaño similar.

Hoy, Microsoft ha anunciado el lanzamiento del modelo Phi-2 con 2.7 mil millones de parámetros. Microsoft Research afirma que este nuevo SLM ofrece un rendimiento de última generación entre los modelos de lenguaje base con menos de 13 mil millones de parámetros. En algunos benchmarks complejos, Phi-2 iguala o supera a modelos hasta 25 veces más grandes.

La semana pasada, Google anunció la suite de modelos de lenguaje Gemini. El Gemini Nano es el modelo más eficiente de Google, construido para tareas en dispositivos y puede ejecutarse directamente en procesadores móviles. Un modelo de lenguaje pequeño como Gemini Nano permite funciones como el resumen de texto, respuestas inteligentes contextuales y corrección avanzada de gramática y ortografía.

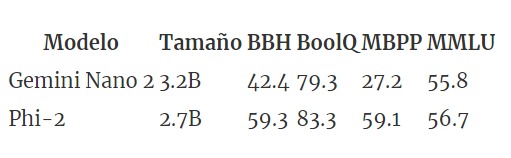

Phi-2 frente a Gemini Nano-2

Según Microsoft, el nuevo modelo Phi-2 iguala o supera al nuevo Google Gemini Nano-2, a pesar de ser más pequeño en tamaño. A continuación, se muestra la comparación de los benchmarks entre los modelos Google Gemini Nano-2 y Phi-2.

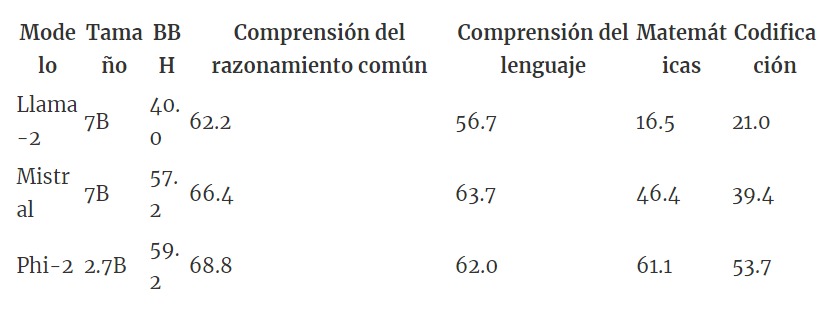

Además de superar a Gemini Nano-2, Phi-2 también supera el rendimiento de los modelos Mistral y Llama-2 con 7B y 13B de parámetros en varios benchmarks. Un éxito increíble para el equipo de Microsoft Research y su pequeño gran modelo.

Mientras que los dos modelos phi anteriores estaban disponibles en Hugging Face, Phi-2 ha sido puesto a disposición en el catálogo de modelos de Azure. Esta plataforma ya ofrece tecnologías a la vanguardia y sin rival.

Fuente: Microsofters